W Inspeerity wierzymy w tworzenie innowacyjnych rozwiązań i dzielenie się naszą wiedzą ze społecznością. To doprowadziło nas do uruchomieniapodcastu"BluzBrothers", oryginalnie w języku polskim, w którym omawiamy różne tematy technologiczne dla programistów. Jeden z odcinków - który miałem przyjemność poprowadzić - skupiał się na wpływie sztucznej inteligencji na programistów, wzbudzając duże zainteresowanie.

Aby udostępnić ten odcinek podcastu na całym świecie, przetłumaczyłem go z języka polskiego na angielski przy użyciu darmowych narzędzi AI. Chodź ze mną, gdy podzielę tę podróż na etapy i zobacz, jak niesamowite są narzędzia do transkrypcji AI!

Wybór odpowiednich narzędzi AI i proces krok po kroku

Pierwszym kluczowym krokiem był wybór odpowiednich narzędzi AI do tego zadania. Przyjrzałem się różnym platformom znanym ze swojego wkładu w uczenie maszynowe i udostępnianie modeli. Oto co znalazłem.

HuggingFace, GPTE i AIToolHunt pozwalają łatwo znaleźć modele i narzędzia, których możesz użyć do rozwiązania swoich wyzwań. Można je filtrować według tagów, słów kluczowych i rekomendacji. Oferują one również centrum modeli, w którym można znaleźć i udostępnić wstępnie wytrenowane modele oraz platformę do dostrajania modeli na niestandardowych zestawach danych. Tak więc, aby je przetestować lub dostosować, nie musisz nawet mieć żadnego środowiska programistycznego na komputerze lokalnym!

*Ten artykuł został napisany pod koniec września 2023 roku, dwa miesiące po wykonaniu mojego tłumaczenia. To tylko dwa miesiące - ale wraz z szybkim rozwojem nowych narzędzi i możliwości sztucznej inteligencji może być już przestarzały.

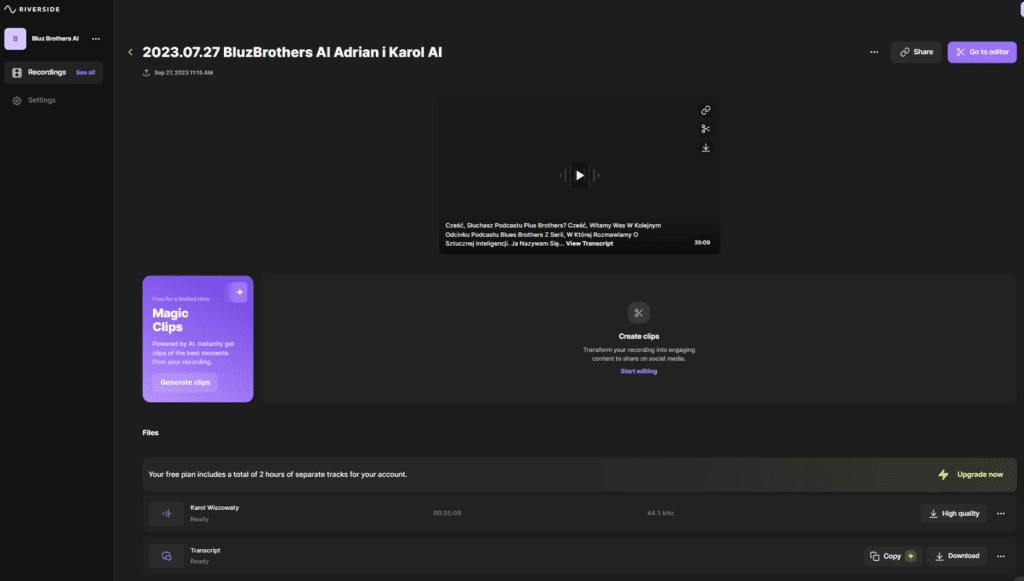

Krok 1: Transkrypcja z Riverside

Aby rozpocząć projekt, zacząłem od poszukiwania narzędzi AI, które mogłyby skutecznie transkrybować zawartość audio naszego podcastu. W szczególności szukałem modeli "transkrypcji". Opcji było wiele, w tym Riverside, Descript, Sonix, AssemblyAI i wiele innych. Po eksperymentach z kilkoma narzędziami, Riverside okazał się najlepszym wyborem dla moich potrzeb.

Kluczową funkcją Riverside był wybór języka wejściowego, niezbędny dla naszego polskiego podcastu, zapewniający dokładne transkrypcje. Oferował również wydajne opcje eksportu, takie jak zapisywanie jako plik SRT lub podział ról, co pozwoliło mi zaoszczędzić cenny czas.

Krok 2: Tłumaczenie za pomocą ChatGPT

Po transkrypcji polskiego podcastu na tekst, następnym krokiem było przetłumaczenie go na język angielski. Zdecydowałem się użyć ChatGPT ze względu na jego kontekstowe zrozumienie. Dostarczając ChatGPT cały kontekst, mogłem upewnić się, że wygenerowane tłumaczenie jest zgodne z zamierzonym znaczeniem, minimalizując błędy i błędne tłumaczenia.

Kolejnym punktem, który wyróżniał ChatGPT była jego wszechstronność. W jednym zapytaniu mogłem poprosić o tłumaczenie na dowolny język.

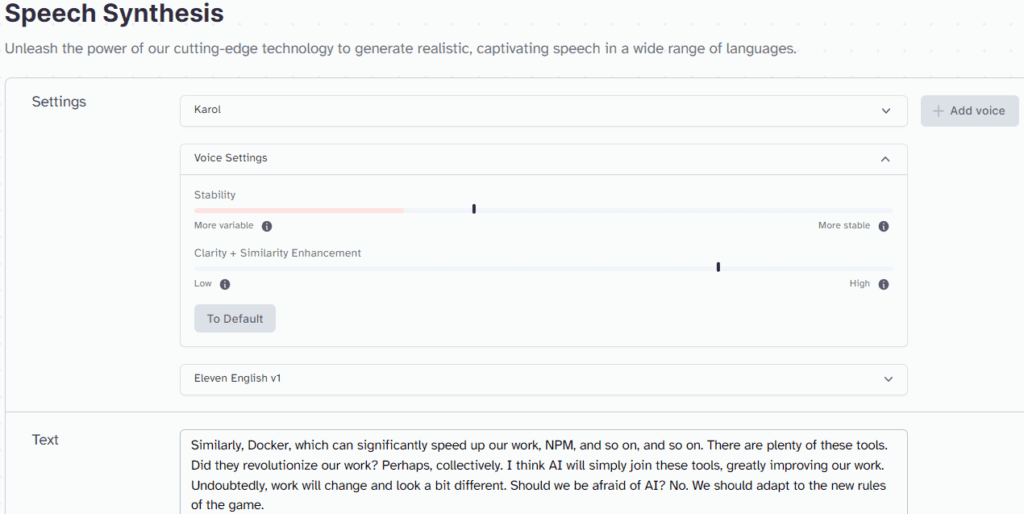

Krok 3: Nagrywanie głosu za pomocą ElevenLabs

Aby ożywić przetłumaczony skrypt, potrzebowałem narzędzia AI do nagrywania głosu. Zbadałem kilka opcji, w tym Descript (ponownie), ElevenLabs, TypecastAI, Synthesys.io i Listnr. Narzędzia te oferowały imponującą gamę głosów do wyboru, w tym kultowe głosy, takie jak Clintona, Obamy, Freddiego Mercury'ego czy Micka Jaggera.

W Inspeerity jesteśmy jednak dumni z tego, że robimy rzeczy sami, po swojemu. Dlatego miałem wyjątkowe wymaganie - chciałem użyć naszych głosów: mojego i mojego kolegi Adriana Oleszczaka, który współprowadził ze mną podcast. Doprowadziło mnie to do poszukiwania narzędzia, które mogłoby zostać przeszkolone na naszych głosach w celu uzyskania dokładnych nagrań.

Początkowo wypróbowałem darmowe narzędzia, ale napotkałem ograniczenia, ponieważ nie obsługiwały one języka polskiego jako języka wejściowego do nauki głosu, co było kluczowe dla poprawy jakości generowanego głosu. Aby temu zaradzić, zainwestowałem 1 dolara w najtańszą licencję ElevenLabs, która pozwoliła nam trenować model AI na naszych głosach i ustawić język polski jako język wejściowy.

ElevenLabs zapewnił elastyczność w dostrajaniu głosów, dostosowując parametry stabilności i przejrzystości głosu, co ma kluczowe znaczenie w przypadkach z artefaktami w tle.

Dzięki ElevenLabs udało mi się wygenerować dwie ścieżki - jedną dla mojego głosu i drugą dla Adriana.

Krok 4: Miksowanie za pomocą Audacity

Ostatnim elementem układanki było zmiksowanie ścieżek głosowych i dopasowanie ich do przetłumaczonego scenariusza. Do tego zadania wykorzystałem Audacity, wszechstronne narzędzie do edycji dźwięku, które już znałem. Chociaż ten krok wymagał bardziej ręcznego podejścia, pozwolił mi zapewnić najwyższy poziom synchronizacji i jakości w ostatecznej angielskiej wersji naszego podcastu.

Zapewnienie jakości

W całym procesie tłumaczenia naszego polskiego podcastu na język angielski przy użyciu sztucznej inteligencji kluczową rolę odgrywało zapewnienie jakości. Ponieważ robiłem to po raz pierwszy, nie byłem pewien rezultatów. Dlatego ta faza była niezbędna do zapewnienia, że produkt końcowy nie tylko spełnia wysokie standardy, ale także pokazuje prawdziwe możliwości obecnych technologii AI.

Krok 1: Monitorowanie

Podczas całej podróży ściśle monitorowałem pracę SI, starając się zminimalizować zakłócenia. Interweniowałem tylko wtedy, gdy było to konieczne, poprawiając rażące błędy (zwykle ograniczone do przypadków, w których pewne słowa lub frazy były niejasne nawet dla rodzimego słuchacza). Poprawki stanowiły mniej niż 0,5% skryptu, pokazując niezwykłą dokładność AI w radzeniu sobie z zadaniem.

Krok 2: Przetwarzanie końcowe

Po wygenerowaniu i nagraniu angielskiego skryptu podcastu, został on poddany post-processingowi. Krok ten obejmował czyszczenie szumów tła ze względu na użycie wstępnie przetworzonego polskiego materiału do treningu głosów (co pokazuje, że sztuczna inteligencja może łatwo naśladować niedoskonałości nagrań, aby uczynić je bardziej naturalnymi). Gdybym użył ostatecznej wersji podcastu, ten krok nie byłby konieczny.

Ręcznie połączyłem również dwie oddzielne ścieżki głosowe, aby zachować naturalny przepływ rozmowy między moim kolegą a mną, co było prostym i szybkim zadaniem.

Krok 3: Testy w świecie rzeczywistym

Ważnym krokiem w zapewnieniu jakości były testy w świecie rzeczywistym. Początkowo testowałem go z kolegami i współpracownikami zaznajomionymi z naszymi głosami. Ich opinie były nieocenione.

Wyniki były fascynujące i uspokajające. Testerzy byli naprawdę pod wrażeniem pracy, zauważając, że głosy generowane przez sztuczną inteligencję bardzo przypominały nasze. Podczas gdy codzienni interaktorzy zauważyli subtelne różnice, niektórzy słuchacze nawet nie zdawali sobie sprawy, że zostały one wygenerowane przez sztuczną inteligencję.

Czy stałem się wielojęzycznym podcasterem? Daj mi znać!

Chętnie poznam wasze opinie. Czy sztuczna inteligencja wykonała dobrą robotę? Poniżej znajdują się linki do polskiej i angielskiej wersji podcastów.

- Język polski, AI - czy deweloperzy powinni się bać?

- Język angielski, AI - Czy deweloperzy powinni się bać?

Nie wahaj się podzielić ze mną swoimi wrażeniami i sugestiami!

Kluczowe wnioski

- Docieranie do każdego i wszędzie. Sztuczna inteligencja to nie tylko fajna technologia - zmienia ona zasady gry, pozwalając każdemu, w dowolnym miejscu, zrozumieć, co mówisz. Wyobraź sobie, że Twoje treści docierają do zakątków świata, o których nawet nie pomyślałeś!

- Ciągły rozwój sztucznej inteligencji. Technologia AI szybko ewoluuje, a nowe narzędzia i możliwości pojawiają się regularnie. Twórcy treści mogą spodziewać się stale poszerzającego się zestawu narzędzi upraszczających zadania, poprawiających jakość i usprawniających procesy pracy.

- Sztuczna inteligencja nie jest doskonała... jeszcze. Sztuczna inteligencja jest świetna, ale wciąż potrzebuje odrobiny ludzkiego dotyku. Kto wie, może za jakiś czas pozwolimy sztucznej inteligencji robić swoje bez żadnej opieki 😊

Przyszłość? Natychmiastowe tłumaczenia! Wyobraź to sobie: Słuchawki wspomagane sztuczną inteligencją i aplikacje, które tłumaczą wszystko w czasie rzeczywistym. Czatowanie z kimś z innego kraju może wkrótce wyglądać tak, jakby był z twojego rodzinnego miasta.

Używane narzędzia i platformy

Podczas mojej podróży miałem przywilej korzystania z kilku niezwykłych narzędzi i zasobów AI. Jestemgłęboko wdzięczny programistom i organizacjom stojącym za tymi narzędziami za ich nieoceniony wkład w tłumaczenie treści oparte na sztucznej inteligencji. Poniżej wymieniam narzędzia i zasoby wykorzystane w tym eksperymencie:

- Riverside: to narzędzie zapewnia doskonałe narzędzie do transkrypcji, które umożliwiło mi precyzyjną konwersję treści audio naszego podcastu do formatu tekstowego. Odkryj Riverside w Riverside.

- ChatGPT by OpenAI: ułatwił tłumaczenie naszego skryptu podcastu na język angielski. Kontekstowe zrozumienie i możliwości językowe ChatGPT odegrały kluczową rolę w osiągnięciu pożądanego przez nas rezultatu. Odkryj ChatGPT na stronie ChatGPT.

- ElevenLabs: to narzędzie umożliwiło mi trenowanie modeli AI na naszych głosach i tworzenie wysokiej jakości nagrań głosowych. ElevenLabs odegrało kluczową rolę w nadaniu naszemu podcastowi autentycznego i angażującego brzmienia. Więcej informacji o ElevenLabs można znaleźć na stronie ElevenLabs.

- Audacity: pozwoliło mi zmiksować i dopracować dźwięk naszego podcastu. Wszechstronność Audacity okazała się niezbędna do osiągnięcia ostatecznego, dopracowanego rezultatu. Odkryj Audacity na stronie Audacity.

- HuggingFace, GPTE i AIToolHunt: te agregatory narzędzi AI pomogły mi odkryć i wybrać odpowiednie narzędzia AI dla mojego projektu. Platformy te łączą społeczność AI i zapewniają dostęp do szerokiej gamy modeli, zestawów danych i aplikacji. Odkryj HuggingFace na HuggingFace, GPTE na GPTE i AIToolHunt na AIToolHunt.

- Microsoft JARVIS: chociaż nie korzystałem z niego w tym projekcie, uznaję Microsoft JARVIS za godne uwagi narzędzie sztucznej inteligencji. JARVIS obiecuje usprawnić tworzenie treści i oferuje ekscytujące możliwości na przyszłość. Zapoznaj się z Microsoft JARVIS na stronie JARVIS.

Jeśli chcesz spróbować przetłumaczyć swoje nagrania lub podcasty, te narzędzia z pewnością ułatwią ci pracę.

Końcowe przemyślenia na temat wydajności AI

Podsumowując, mój eksperyment polegający na przetłumaczeniu polskiego podcastu na język angielski przy użyciu sztucznej inteligencji okazał się ogromnym sukcesem. Sztuczna inteligencja nie tylko spełniła, ale często przewyższyła moje oczekiwania, zwłaszcza biorąc pod uwagę, że tworzyła treści w języku angielskim, którego nigdy wcześniej nie słyszała. Projekt podkreślił niezwykłe możliwości sztucznej inteligencji w przełamywaniu barier językowych i tworzeniu angażujących, autentycznych treści.

Jeśli podobał Ci się ten artykuł - pozostań z nami w mediach społecznościowych , aby być na bieżąco z najnowszymi osiągnięciami w dziedzinie technologii, rozwoju oprogramowania i sztucznej inteligencji. A jeśli jesteś programistą - zasubskrybuj nasz podcast Bluzbrothers!